Su Kickstarter c’è un dispositivo delle dimensioni di uno smartphone che dichiara di girare modelli da 120 miliardi di parametri a 40 token al secondo, consuma 30 watt, e costa $1.299. Un altro promette un server AI domestico completo con RTX 5090 Mobile, Kubernetes integrato e dashboard da grande azienda.

Se ti sembra troppo bello per essere vero per il primo — hai il tuo senso critico calibrato bene. Il secondo è più onesto, ma nasconde comunque un trabocchetto che pochissimi spiegano.

Questi prodotti sono utili come provocazione: ci costringono a fare i conti. E quando si fanno i conti, si scopre che il vero problema dell’AI locale non è mai stata la potenza — è il collo di bottiglia tra memoria e processore. Tutto il resto è marketing.

“Quando ho visto il Tiiny AI dichiarare 40 token/s su 120B parametri con 200 GB/s di bandwidth, ho fatto i conti su un foglio. Non tornano. La fisica non mente. Il problema dell’AI locale non è mai stata la potenza di calcolo — è sempre stata la bandwidth. E chi non lo dice chiaramente ha qualcosa da nascondere.”

Prima di iniziare: cos’è davvero fare AI in locale?

Se non hai mai visto un LLM girare su hardware locale, questi due video mostrano la differenza concreta tra hardware sbagliato e hardware giusto — stessa domanda, stessa risposta:

🐌 2 tok/s — Modello denso e hardware con PCIe bottleneck

Llama 70B denso su GPU con bus lento

⚡ 50 tok/s — memoria unificata ad alta bandwidth

Qwen 35B MoE su NVIDIA GB10

Stessa risposta, hardware diverso. La differenza si chiama bandwidth di memoria — ed è il tema di questo articolo.

Su Kickstarter c’è un dispositivo delle dimensioni di uno smartphone che dichiara di girare modelli da 120 miliardi di parametri a 40 token al secondo, consuma 30 watt, e costa $1.299. Un altro promette un server AI domestico completo con RTX 5090 Mobile, Kubernetes integrato e dashboard da grande azienda.

Se ti sembra troppo bello per essere vero per il primo — hai il tuo senso critico calibrato bene. Il secondo è più onesto, ma nasconde comunque un trabocchetto che pochissimi spiegano.

Questi prodotti sono utili come provocazione: ci costringono a fare i conti. E quando si fanno i conti, si scopre che il vero problema dell’AI locale non è mai stata la potenza — è il collo di bottiglia tra memoria e processore. Tutto il resto è marketing.

1. Il vero problema dell’inferenza LLM locale: non è la potenza di calcolo

Il malinteso più diffuso: più TFLOPS o TOPS = più velocità. È falso, almeno per l’inferenza LLM.

Quando un modello genera un token, deve leggere tutti i suoi parametri dalla memoria ogni singola volta. Un modello da 70 miliardi di parametri in Q4 pesa circa 40 GB. Con 273 GB/s di bandwidth (GB10), il tetto teorico è ~6-7 tok/s. Con 89 GB/s (Ryzen AI mini PC entry), scende a ~2.2 tok/s. La velocità scala quasi linearmente con la bandwidth di memoria, non con i TFLOPS.

Caso concreto: la RTX 5090 costa da sola €3.000-3.500. Aggiungi CPU, RAM e scheda madre e sei a €5.000+ — per avere meno flessibilità sul contesto lungo rispetto a un GB10 da €3.900, perché la GPU rimane separata dalla RAM di sistema via un bus PCIe che vale ~32 GB/s reali. Non appena il modello trabocca dalla VRAM, quella penalità annulla tutti i TFLOPS.

Facciamo i conti anche sul Tiiny AI Pocket Lab che ha raccolto $1 milione su Kickstarter: con 200 GB/s di bandwidth e un modello da 120B in INT4 (60 GB), il massimo fisico è ~3 token/s. Non 40. L’unica spiegazione plausibile è che usino un modello MoE con pochi miliardi di parametri attivi — e il marketing conti quelli totali.

2. Da CUDA al GB10: storia del collo di bottiglia hardware nell’AI locale

L’era CUDA e il dominio NVIDIA

Per capire perché il mercato dell’AI locale è così complicato nel 2026, bisogna tornare al 2007. Quell’anno NVIDIA lancia CUDA, un framework che permette di usare le GPU per calcoli generici. All’inizio nessuno ci crede. Poi nel 2012 arriva AlexNet, che vince la ImageNet competition girata su due GTX 580. Da quel momento l’intero mondo della ricerca AI converge su NVIDIA. Quindici anni dopo, CUDA è diventata un fossato competitivo quasi invalicabile: ogni libreria AI seria — PyTorch, vLLM, TensorRT — è ottimizzata per CUDA.

Questa dipendenza ha un effetto collaterale: GPU e CPU sono rimaste separate, collegate da un bus PCIe che è veloce per un bus, ma lentissimo per una memoria.

Il collo di bottiglia PCIe

Immagina una biblioteca enorme (RAM di sistema, 128 GB) collegata a una sala di lettura ultrarapida ma minuscola (VRAM della GPU, 24 GB) attraverso un corridoio stretto (bus PCIe). Quando il modello entra tutto nella VRAM, tutto funziona benissimo. Appena supera quella soglia e deve attingere alla RAM via PCIe, la velocità crolla: da ~1.000 GB/s interni alla VRAM a ~32 GB/s reali sul bus — una penalità di 30x.

La soluzione Apple (2020): RAM unificata

Nel novembre 2020 Apple presenta il chip M1 con la Unified Memory Architecture: CPU e GPU condividono lo stesso pool di memoria fisica, senza corridoio stretto. Era il 2020 — Apple aveva risolto il problema su un laptop da $999. Il problema? Niente CUDA. Per anni, la soluzione più elegante era inutilizzabile per chi faceva AI sul serio.

La risposta AMD: RAM saldata al processore

AMD ha seguito una strada simile con il Ryzen AI Max+: HBM saldata fisicamente accanto al chip, con un bus così corto da eliminare la latenza. CPU e GPU accedono allo stesso pool (fino a 128 GB LPDDR5X) senza bottleneck PCIe. Bandwidth: ~89-256 GB/s a seconda della configurazione. Il vantaggio rispetto ad Apple: gira Windows e Linux, con ROCm e Ollama funzionanti.

NVIDIA GB10: la risposta tardiva — ma con CUDA

Nel 2025 NVIDIA risponde con il chip GB10 Grace Blackwell: CPU ARM Grace + GPU Blackwell collegati tramite NVLink-C2C che sostituisce il PCIe. Risultato: 128 GB di memoria unificata a 273 GB/s, con CUDA nativo — l’unico dispositivo consumer che offre entrambe le cose.

Apple ha inventato la soluzione nel 2020. AMD l’ha democratizzata nel 2024. NVIDIA l’ha resa CUDA-compatibile nel 2025. Il mercato ha impiegato cinque anni a capire che il vero collo di bottiglia non era la GPU — era il bus.

3. Benchmark reali 2026: GB10, RTX 4090 e Mac Mini M4 a confronto

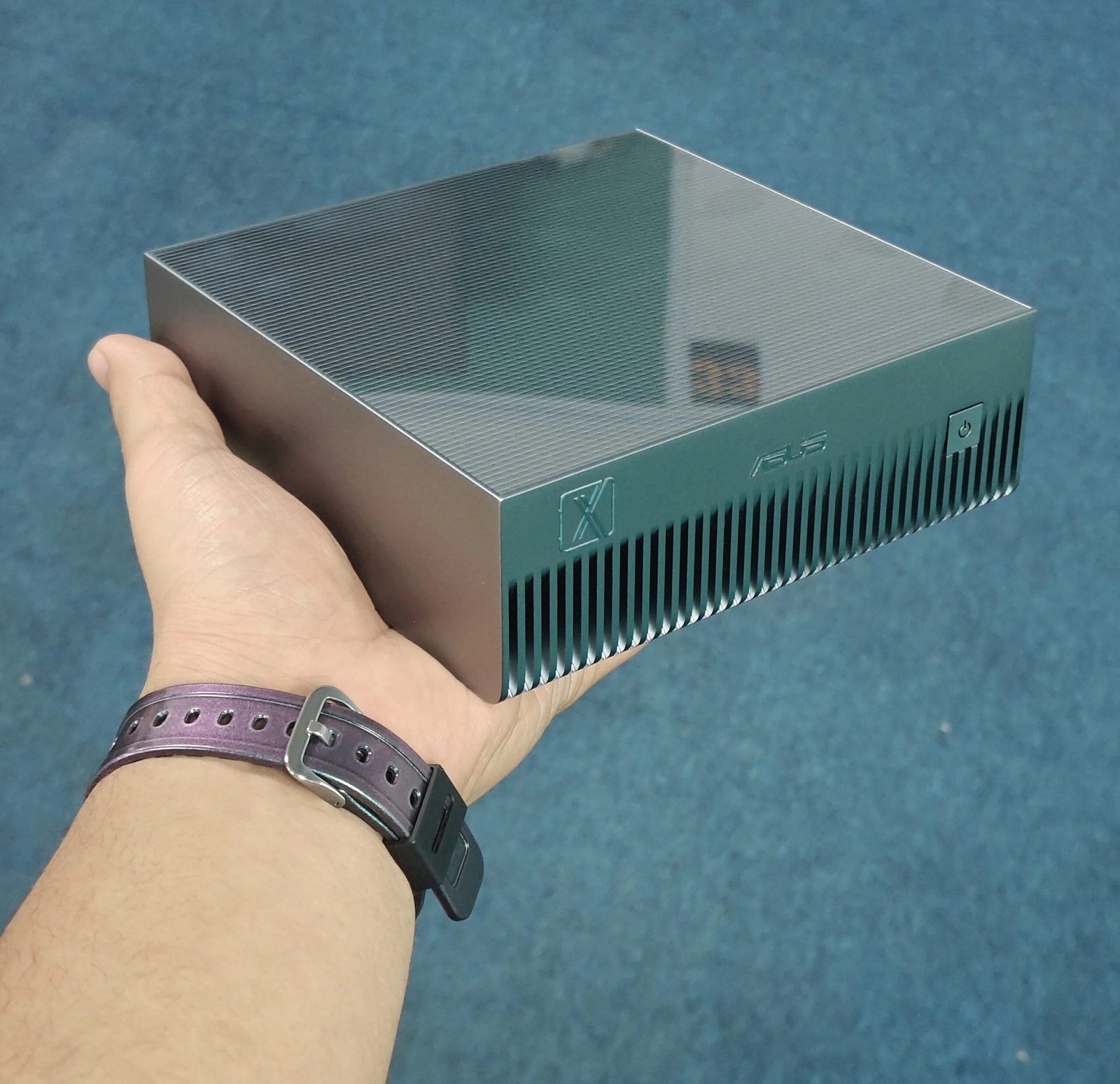

ASUS Ascent GX10 vs Dell Pro Max GB10: stessa macchina, guscio diverso

Entrambi i dispositivi usano lo stesso chip NVIDIA GB10 Superchip. Le prestazioni AI sono funzionalmente identiche. Le differenze sono solo di design e specifiche marginali.

| Caratteristica | ASUS Ascent GX10 | Dell Pro Max GB10 |

|---|---|---|

| Chip | NVIDIA GB10 Superchip | NVIDIA GB10 Superchip |

| RAM | 128 GB LPDDR5X, 273 GB/s | 128 GB LPDDR5X, 273 GB/s |

| AI Performance | 1 PFLOP FP4 | 1 PFLOP FP4 |

| Storage base | 1 TB PCIe 4.0 | 2 TB NVMe |

| Alimentatore | 240W | 280W |

| Rete | 10GbE + 2× 200GbE (ConnectX-7) | 10GbE + 2× 200GbE (ConnectX-7) |

| Peso | 1,6 kg | 1,34 kg |

| Prezzo IT | ~€3.900-4.200 | ~€4.263 + IVA |

ASUS ha il pulsante di accensione fisico frontale e consumi leggermente inferiori; Dell ha build quality premium con pannelli metallici magnetici e più storage di base. Per un uso AI/ML development, offrono esattamente la stessa potenza computazionale.

Il dato che cambia le decisioni: Qwen 70B sul GB10 è lento

Un Qwen 70B su GB10 con llama.cpp in Q4 produce ~4.7 tok/s in generazione. Il parlato umano è ~3-4 parole al secondo: 4.7 tok/s non è interattivo.

| Formato | Dimensione in RAM | Tok/s generazione |

|---|---|---|

| FP16 (pieno) | ~140 GB | ❌ Non entra |

| FP8 | ~70 GB | ~2.7 tok/s |

| Q4 (llama.cpp) | ~40 GB | ~4.7 tok/s |

| NVFP4 + TensorRT-LLM | ~35 GB | ~30-40 tok/s (stimato) |

Il sweet spot del GB10: Qwen 34B in FP16 raggiunge ~61 tok/s. Ma il vero game-changer sono i modelli MoE (vedi sezione 4).

AMD Ryzen AI Max+: la scelta democratica

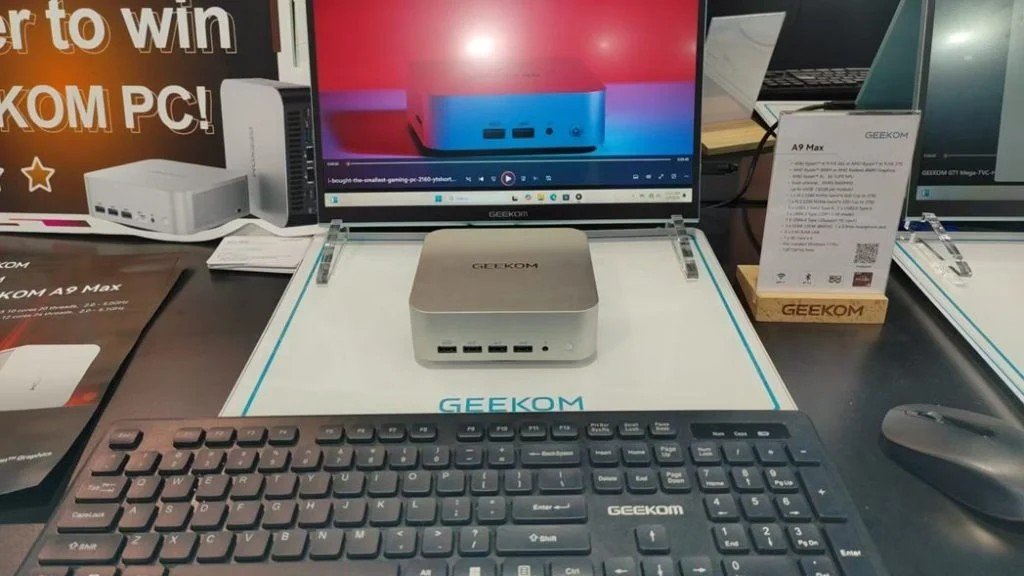

Geekom A9 Max e equivalenti: ~€999-1.200, 128 GB LPDDR5X, ~89-256 GB/s di bandwidth. ROCm compatibile, Ollama e llama.cpp funzionanti. Il Qwen 70B produce ~2.2 tok/s. Il sweet spot è sui modelli MoE leggeri (7B-35B).

Apple Mac Studio M4 Max: la carta nascosta

Il Mac Studio M4 Max con 546 GB/s di bandwidth batte il GB10 (273 GB/s) quasi 2:1 su modelli che ci entrano entrambi. Il limite resta CUDA: vLLM, TensorRT-LLM, training PyTorch non girano su Metal. Sul TCO: Mac Mini M4 Pro consuma ~40W sotto inferenza, una RTX 4090 ~400W — in 3 anni il risparmio energetico paga il Mac Mini.

4. Mixture of Experts (MoE): la chiave per girare LLM grandi su hardware consumer

Nel 2025-2026 l’industria abbraccia i modelli Mixture of Experts (MoE): architetture con molti miliardi di parametri totali ma solo una frazione attiva per ogni token. Oltre il 60% dei nuovi modelli open source usa MoE — DeepSeek-R1, Kimi K2, Qwen 3.5, Llama-4 Scout.

Come funziona: ogni modello MoE ha un router che per ogni token seleziona solo 2-4 “esperti” su decine o centinaia disponibili. Si attivano solo 3-22 miliardi di parametri per token, anche su modelli da 120B o 671B totali. Meno parametri attivi = meno dati da leggere = molti più token al secondo.

Il dato che cambia tutto: Qwen 35B-A3B (MoE) con NVFP4 su GB10 raggiunge 82-102 tok/s stabili. Lo stesso hardware che produce 4.7 tok/s su un 70B denso.

| Modello | Parametri totali | Parametri attivi/token | Tok/s su GB10 |

|---|---|---|---|

| Llama 3.3 70B (denso) | 70B | 70B | ~4.7 tok/s |

| Qwen 34B FP16 | 34B | 34B | ~61 tok/s |

| Qwen 35B-A3B (MoE) NVFP4 | 35B | 3.3B | 82-102 tok/s |

| Qwen 122B-A10B (MoE) INT4 | 122B | 10B | ~27-29 tok/s |

| Qwen 235B-A22B (MoE) FP4 | 235B | 22B | velocità interattiva |

MoE apre la strada ai rig multi-GPU

La distribuzione degli esperti su GPU multiple è naturale: ogni GPU ospita un sottoinsieme di esperti, il router decide quale GPU contattare per ogni token. Con vLLM e tensor parallelism, due RTX 4090 (48 GB VRAM totali) fanno girare Qwen 122B-A10B a 15-20 tok/s a €4.500 di hardware.

MoE apre la strada ai cluster di mini PC

Exo è il framework open source che rende possibile questo: discovery peer-to-peer automatico, API compatibile con ChatGPT, supporto hardware eterogeneo. Un cluster di 4 Framework Desktop con Ryzen AI Max+ 395 (€4.400 totali, 256 GB RAM distribuiti) produce 65 tok/s aggregati su Qwen 122B-A10B — con latenza di 150-200ms, ideale per batch ma non per chat real-time.

5. Contesto lungo e RAG: il benchmark che le schede tecniche non mostrano

I benchmark a 512 token sono marketing. I workload reali — RAG su documentazione aziendale, analisi contratti, agenti multi-step — operano a 16K-128K token. Su quella fascia le differenze diventano drammatiche per via del KV cache.

| Setup | Contesto 512 tok | Contesto 16K tok | Contesto 128K tok |

|---|---|---|---|

| GB10 — Qwen 35B-A3B MoE | 167 tok/s | 47 tok/s | 7.6 tok/s |

| GB10 — Llama 3.3 70B denso | ~4.7 tok/s | ~4.2 tok/s | ~3 tok/s |

| Ryzen AI Max+ — Qwen 35B MoE | 55 tok/s | 15 tok/s | 2.5 tok/s |

| 2x RTX 4090 — Qwen 122B MoE | 380 tok/s (batch) | ~80 tok/s | limite VRAM |

Regola pratica: se il tuo caso d’uso è RAG o agenti conversazionali, il contesto medio reale è 16K-32K token. Su quella fascia il GB10 con un modello MoE produce risultati 3-5x superiori al Ryzen AI entry-level.

6. Oltre le GPU: FPGA e ASIC

FPGA: flessibilità totale, complessità alta

Le FPGA (Field-Programmable Gate Array) sono chip riprogrammabili. Per LLM offrono latenza deterministica, efficienza energetica e possibilità di implementare quantizzazioni esotiche (1-bit, 2-bit) direttamente nell’hardware. I player principali sono AMD Xilinx (Alveo U55C, U280) e Intel Agilex. La programmazione richiede VHDL/HLS — non è accessibile come una GPU.

ASIC: efficienza massima, zero flessibilità

| Chip ASIC | Chi | Focus | Note |

|---|---|---|---|

| TPU v6 (Trillium) | Training + inferenza cloud | Solo GCP, non venduto | |

| Trainium 2 | AWS | Training cloud | Solo EC2 |

| Groq LPU | Groq | Inferenza ultra-veloce | 500+ tok/s su 70B, cloud |

| Tenstorrent n300S | Ex-AMD team | Inferenza locale/edge | Acquistabile, ~$1.400 |

| Cerebras WSE-3 | Cerebras | Training/inferenza wafer-scale | Solo data center |

Tenstorrent n300S (~$1.400, CEO: Jim Keller, ex AMD/Apple) è l’unico ASIC acquistabile a prezzi semi-accessibili. Groq ha dimostrato che con SRAM on-chip invece di DRAM esterna si raggiungono 500+ tok/s su Llama 3.1 70B — impossibili con qualsiasi GPU consumer. Il 2027 porterà sorprese.

6b. Mini PC AI low-cost: costruire un rack con due PC da €570

Un rack AI funzionante si costruisce anche con due mini PC da €400-600 l’uno — a patto di scegliere bene il chip. Il discriminante non è il nome della CPU, ma l’architettura della GPU integrata e la velocità della RAM.

Il riferimento: Ryzen 780M RDNA 3 + DDR5 5600MHz

I mini PC con Ryzen 7 7840HS, 8845HS o equivalenti con Radeon 780M (RDNA 3) e RAM DDR5 a 5600MHz sono il punto di partenza corretto. Esempio: Thomson W3, Geekom A7 Pro, Minisforum UM890 Pro.

- Qwen 9B Q4: 10-15 tok/s — velocità di lettura umana, usabile per chat e agenti background

- Qwen 14B Q4: 7-10 tok/s — ancora interattivo per task non critici

- Qwen 35B-A3B Q4 (MoE): 12-18 tok/s su nodo singolo

- Config BIOS: UMA Frame Buffer 8-16 GB; backend Vulkan; contesto max ~8K token

Cosa NON prendere: mini PC con Ryzen 9 6900HX (Minisforum UM690L) — GPU Radeon 680M RDNA 2: soli 3.3 TFLOPS contro 8+ della 780M, RAM max 4800MHz (-16% tok/s), ROCm problematico. Il “Ryzen 9” suona meglio del “Ryzen 7”, ma per l’AI locale è un passo indietro.

Il cluster a due nodi: come collegarlo senza switch

Per due nodi non serve uno switch né un cavo crossover. Le schede di rete moderne supportano Auto-MDI/MDIX: basta un cavo Cat6a dritto. Nodo 1: IP statico 10.0.0.1. Nodo 2: 10.0.0.2. Internet via Wi-Fi integrato. Switch necessario solo dal terzo nodo in poi.

| Setup rack | Costo totale | RAM totale | Modelli praticabili | Tok/s cluster |

|---|---|---|---|---|

| 2x mini PC Ryzen 780M (32GB) | ~€800-1.000 | 64 GB | Qwen 9B-14B | 20-30 (aggregati) |

| 2x mini PC Ryzen 780M (96GB) | ~€1.200-1.600 | 192 GB | Qwen 35B-A3B MoE | 25-40 (aggregati) |

| 4x mini PC Ryzen AI Max+ (64GB) | ~€4.400 | 256 GB | Qwen 122B-A10B MoE | 65 (aggregati) |

“Avendo in passato costruito miner per Ethereum da 8 GPU, sfruttando la nostalgia sto valutando di fare un rack mini PC e poi chissà — magari anche un rig di 4 RTX 3090 da 24 GB di VRAM.”

6c. Rack AI professionale per PMI: cluster NVIDIA GB10 Blackwell

Due ASUS Ascent GX10 (o Dell Pro Max GB10) collegati in cluster sono l’infrastruttura AI più potente acquistabile oggi per uso locale — con caratteristiche che fino a un anno fa richiedevano hardware da data center.

Perché due GB10 cambiano paradigma

- 256 GB di memoria unificata a 273 GB/s per nodo — Qwen 122B-A10B ci entra con margine, 27-29 tok/s su nodo singolo

- CUDA nativo: vLLM distributed e TensorRT-LLM funzionano out-of-the-box

- 10GbE + 2× 200GbE (ConnectX-7): trasferimento tensori 4-8x più veloce dei mini PC consumer

- Qwen 235B-A22B MoE: con 256 GB totali distribuiti gira a velocità interattiva

Networking del cluster GB10

Collegamento diretto nodo-nodo via 10GbE (Auto-MDI/MDIX, cavo Cat6a). Switch 10GbE managed (es. MikroTik CRS309, ~€200) solo dal terzo nodo.

| Setup | Costo totale | RAM totale | Modello top | Performance |

|---|---|---|---|---|

| 1x GB10 | ~€3.900-4.200 | 128 GB | Qwen 35B-A3B NVFP4 | 82-102 tok/s |

| 2x GB10 cluster | ~€8.000-8.500 | 256 GB | Qwen 235B-A22B MoE | velocità interattiva |

| 3x GB10 cluster | ~€12.000 | 384 GB | DeepSeek-R1 671B MoE | 10-15 tok/s |

7. La matrice decisionale

💰 Budget <€1.500 — tre strade

| Setup | Prezzo IT | Pro | Contro |

|---|---|---|---|

| 🧱 Rack 2x mini PC Ryzen 780M es. Thomson W3 (32GB) |

~€1.140 (€570 × 2) |

Cluster DIY con Exo/llama.cpp, collegamento diretto Cat6a senza switch. Qwen 9B-14B a 20-30 tok/s aggregati. RAM espandibile. | Configurazione Linux richiesta. Solo Vulkan/ROCm, nessun CUDA. |

| 💻 Geekom A9 Max singolo Ryzen AI 9 HX 370, 128GB |

~€1.281 (geekom.it) |

Nodo potente plug-and-play, Radeon 890M 80 TOPS NPU, RAM fino a 128 GB. Qwen 35B-A3B Q4 a 15-18 tok/s. | Nessun CUDA. |

| 🍎 Mac Mini M4 Pro 24GB | ~€1.499 (Apple IT) |

273 GB/s unified memory, 40W sotto inferenza, silenzio totale, TCO ottimale, MLX eccellente. Qwen 14B a ~30 tok/s. | Nessun CUDA — no training/vLLM produzione. |

💼 Budget €3.000-5.000 — due soluzioni serie

| Setup | Prezzo IT | Pro | Contro |

|---|---|---|---|

| 🖥️ PC con RTX 4090 (sistema completo) |

~€4.000-4.500 | CUDA nativo, training, fine-tuning, vLLM. 24 GB GDDR7 ~1 TB/s interni. Qwen 35B-A3B AWQ a 24-28 tok/s con il modello in VRAM. | RTX 4090 nuova = €2.990 solo GPU (Amazon IT) + CPU + RAM + scheda madre. PCIe bottleneck a 32 GB/s reali appena il modello supera i 24 GB. |

| 💡 ASUS Ascent GX10 / Dell Pro Max GB10 | €3.916 IVA inclusa (senetic.it) |

128 GB memoria unificata a 273 GB/s + CUDA nativo. Qwen 35B-A3B NVFP4 a 82-102 tok/s. Contesti 128K+ fluidi. Pronto all’uso. | ARM (non x86). Modelli densi 70B: solo 4.7 tok/s — usare sempre MoE. |

🚀 Budget >€5.000 — rack con Blackwell

| Setup | Prezzo IT | Quando ha senso |

|---|---|---|

| 🔥 Rig 2x RTX 4090 | ~€5.000-6.500 | Serving multi-utente, vLLM tensor parallelism, Qwen 122B-A10B MoE a 15-20 tok/s, latenza 25ms. La scelta per chi vuole costruire il rig (nostalgia da miner inclusa). |

| ⚡ Rack 2x GB10 (Blackwell cluster) | ~€8.000 | 256 GB memoria unificata totale, CUDA + 10GbE nativo, Qwen 235B-A22B MoE a velocità interattiva. L’infrastruttura AI più potente acquistabile oggi per uso locale. Per PMI con RAG intensivo su modelli 100B+. |

8. Il parere di chi lo usa

“Quando ho visto il Tiiny AI dichiarare 40 token/s su 120B parametri con 200 GB/s di bandwidth, ho fatto i conti su un foglio. Non tornano. La fisica non mente. Il problema dell’AI locale non è mai stata la potenza di calcolo — è sempre stata la bandwidth. E chi non lo dice chiaramente ha qualcosa da nascondere.”

9. Futuro dell’AI locale: ASIC, MoE e nuovi chip nel 2027

- ASIC consumer accessibili: Tenstorrent n300S (~$1.400) già acquistabile. Groq ha dimostrato che 500+ tok/s su 70B è fisicamente possibile. Il paradigma GPU potrebbe essere sovvertito entro 18 mesi.

- MoE diventa lo standard assoluto: i modelli densi 70B+ diventeranno niche. Kimi K2 ha già 1.2 trilioni di parametri totali con decine di miliardi attivi per token.

- Cluster mini PC maturi: con la maturazione di Exo e il miglioramento del NPU su Ryzen AI, la latenza di cluster scenderà sotto i 100ms — soglia per l’uso interattivo.

- Memoria unificata come commodity: AMD scala il concetto, Intel segue. La differenza tra GB10 e Ryzen AI si ridurrà entro il 2027.

10. Conclusione

Nel 2026 girare un LLM potente in locale è possibile per qualsiasi PMI. La scelta dell’hardware sbagliato — attirata da TOPS gonfiati o specifiche difficili da verificare — può trasformare un investimento serio in una delusione da 4 token al secondo.

Le due regole semplici: guarda la bandwidth di memoria, non i TFLOPS. E guarda se la memoria è unificata o separata dalla GPU. Poi scegli il modello MoE giusto — è lì che si vince davvero.

- Uso personale / prototipazione → Ryzen AI 128GB + Qwen 35B-A3B

- Ecosistema Apple, silenzio, TCO → Mac Mini M4 Pro 64GB

- CUDA + qualità massima → GX10 + Qwen 35B-A3B NVFP4 (82-102 tok/s)

- Batch processing, contesti enormi → Cluster 4x mini PC + Exo

- Produzione multi-utente → 2-4x RTX 4090 + vLLM

I Kickstarter che promettono l’impossibile? Teneteli come benchmark mentale. Se i conti non tornano sulla fisica, non tornano neanche sul prodotto finito.

📌 Vuoi approfondire l’AI locale per la tua azienda? Entra nella community BRIX-IA: t.me/brixia