È appena uscito MiniMax M2.7, disponibile già su Ollama — anche se per ora solo in modalità cloud. E non è il solito aggiornamento incrementale: questo modello ha partecipato attivamente alla propria evoluzione. Nel senso letterale.

Ma partiamo dall’inizio.

Chi è MiniMax e Perché Dovresti Conoscerla

MiniMax è una startup cinese fondata a Shanghai, supportata da Alibaba e Tencent, con un focus sempre più dichiarato sull’intelligenza artificiale enterprise. Nel 2025 ha completato un IPO a Hong Kong da 600 milioni di dollari e ha aumentato i ricavi da servizi API/enterprise del +197,8% in un anno (da $8,7M a $26M).

La traiettoria è chiara: vogliono diventare l’alternativa competitiva agli stack OpenAI e Anthropic — con prezzi radicalmente più bassi e un’architettura pensata per gli agenti AI. Se vuoi capire meglio il panorama degli agenti generalisti, abbiamo fatto un confronto dettagliato tra MiniMax, Manus e GenSpark.

La serie di modelli M2 segue questa evoluzione:

| Modello | Periodo | Focus |

|---|---|---|

| MiniMax-Text-01 | Early 2025 | Finestra contesto fino a 4M token |

| M2 / M2.1 | Mid-2025 | Coding multi-language, office automation |

| M2.5 | Late 2025 | SWE-bench 80,2%, costi 10-20x inferiori ai competitor |

| **M2.7** | **Marzo 2026** | **Self-evolution, software engineering avanzato** |

M2.7: Il Modello che Ha Scritto Parte di Se Stesso

Il titolo dell’annuncio ufficiale dice tutto: “Early Echoes of Self-Evolution”.

Cosa significa nella pratica? Durante lo sviluppo di M2.7, MiniMax ha lasciato che una versione interna del modello:

- aggiornasse la propria memoria e costruisse skill complesse nel suo agent harness

- ottimizzasse scaffold di reinforcement learning in loop autonomi

- iterasse autonomamente su 100+ round di “analizza fallimenti → pianifica modifiche → modifica il codice → esegui valutazioni → confronta risultati → decidi se tenere o revertire”

Il risultato? Un miglioramento del 30% sulle valutazioni interne senza intervento umano — confermato da VentureBeat.

È il primo esempio documentato di un modello commerciale che partecipa significativamente alla propria evoluzione. Non è AGI, ma è un passo concreto verso sistemi AI in grado di migliorarsi in modo autonomo.

Cosa Sa Fare M2.7 in Contesti Business

1. Software Engineering Reale (Non Solo Benchmark)

M2.7 ottiene 56,22% su SWE-Pro — praticamente al livello di Claude Opus. Ma il dato più interessante non è il benchmark: è il caso d’uso in produzione.

Ecco come si presenta una sessione di incident response reale con M2.7:

💬 Incident Response — sistema e-commerce in produzione (ore 03:47)

Abbiamo un spike di latenza sull’endpoint /checkout. Errori 504 negli ultimi 8 minuti. Ho bisogno di capire cos’è successo.

Sto correlando i deployment timeline con le metriche di monitoring degli ultimi 30 minuti. Trovato: deploy delle 03:31 ha introdotto una migration DB non completata. La query su orders_pending ora fa full table scan su 2.3M righe invece di usare l’indice. Sto generando la MR con un hotfix non-bloccante.

Quanto ci vuole per il fix?

MR pronta. Tempo stimato di deploy: 4 minuti. Nel frattempo ho aggiunto un flag feature per disabilitare la query costosa e servire una risposta cached. Latenza dovrebbe tornare normale in 90 secondi dopo il merge.

Risultato documentato: tempi di recovery ridotti a meno di 3 minuti.

Per chi gestisce sistemi in produzione, questo non è poco.

2. Office Suite — Il Differenziatore Nascosto

Questo è forse il dato più sorprendente per chi pensa a MiniMax solo come modello di coding.

Su GDPval-AA — una valutazione cross-settoriale su 45 modelli che misura la capacità di lavorare con documenti professionali — M2.7 ottiene un ELO di 1495, il più alto tra tutti i modelli open-source.

Un esempio concreto di editing documentale con M2.7:

💬 Revisione contratto — studio legale

Ho questo contratto di fornitura da 34 pagine. Devo identificare le clausole di responsabilità limitata e confrontarle con il nostro template standard.

Analizzate 34 pagine. Trovate 6 clausole di responsabilità limitata: artt. 8.2, 11.4, 12.1, 15.3, 18.7, 22.1. Rispetto al vostro template standard ho identificato 3 difformità rilevanti: (1) il cap di responsabilità all’art. 8.2 è al 50% del valore contrattuale vs il vostro standard del 100%; (2) manca la clausola di forza maggiore per eventi cyber; (3) l’art. 22.1 esclude i danni indiretti anche per dolo. Vuoi che prepari una redline con le modifiche suggerite?

Sì, e aggiungi una nota esplicativa per il cliente su ogni modifica.

Per team che lavorano molto su suite Office, questo è un vantaggio concreto.

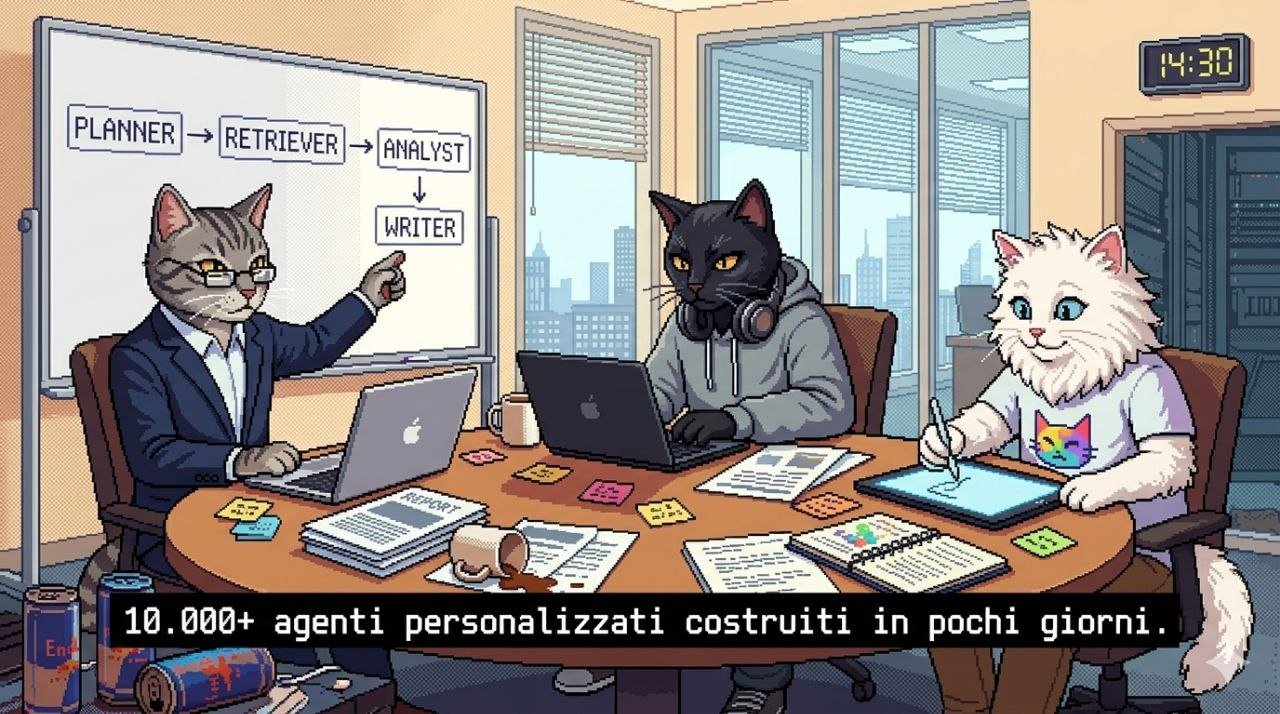

3. Agent Teams per Workflow Complessi

M2.7 supporta nativamente la costruzione di Agent Teams — sistemi multi-agente in cui diversi agenti specializzati (planner, retriever, executor) collaborano su task complessi. Questo segna un cambio di paradigma rispetto ai vecchi workflow a nodi: se vuoi capire perché, leggi il nostro articolo su OpenClaw vs n8n e il passaggio all’approccio agentico.

Ecco un esempio pratico di come funziona un team di agenti per una ricerca di mercato:

💬 Research Agent Team — analisi competitor (PMI manifatturiera)

Ho bisogno di un’analisi dei principali competitor nel settore imballaggio sostenibile in Italia. Budget limitato, niente consulenti esterni.

Avvio il team. Assegno: Retriever Agent per raccolta dati pubblici, Analyst Agent per confronto prezzi e posizionamento, Writer Agent per il report finale. Stima: 45 minuti. Ti aggiorno ai decision point critici.

(dopo 38 minuti) Analisi completata su 7 competitor. Ho identificato un gap di posizionamento: nessuno comunica il carbon footprint per unità di prodotto. È un’opportunità di differenziazione non presidiata. Vuoi che approfondisca questa direzione nel report?

Sì, focalizzati su quello.

Report pronto (14 pagine). Include: benchmark competitor, gap analysis, 3 scenari di posizionamento con stima effort/impatto, e una bozza di messaging per il sito.

La piattaforma MiniMax Agent conta già oltre 10.000 agenti personalizzati costruiti in pochi giorni su domini specifici.

4. Voice AI per Customer Service

Spesso dimenticato nel dibattito tecnico: MiniMax ha un’infrastruttura voice AI con latenza sotto i 500ms, supporto barge-in e context retention. Adatta a call center enterprise che vogliono sostituire o augmentare operatori umani su flussi standard.

Il Vantaggio Competitivo Reale: Il Prezzo

I benchmark sono utili, ma in azienda conta anche quanto costa.

- Claude Sonnet 4 vs MiniMax-01: 15x più costoso per input token

- M2.5 vs GPT equivalente su SWE-bench: 10-20x più economico

Per chi vuole deployare agenti AI in produzione su volumi significativi, questa differenza di costo è spesso il fattore decisivo.

Come Iniziare

MiniMax è accessibile tramite:

- minimax.io — piattaforma web con agenti preconfigurati

- API unificata — text, voice, vision in un unico endpoint

- Ollama (

ollama run minimax-m2.7:cloud) — per chi usa già Ollama nei propri workflow - Make.com — integrazione diretta per automazioni no-code

- Claude Code / Codex / OpenClaw — M2.7 è già compatibile come modello alternativo

La Community Tecnica: Cosa Dicono

Le reazioni sui forum specializzati sono istruttive per capire dove M2.7 funziona davvero.

Il secondo commento è particolarmente utile: M2.7 eccelle quando può esplorare il contesto in profondità, ma può “perdere tempo” su task vincolati dalla velocità.

Attenzione: Le Limitazioni Reali

Onestà intellettuale prima di tutto.

La comunità tecnica su Hacker News è cauta: “MiniMax non è adatto per alta autonomia su progetti complessi”. I benchmark sono ottimi, ma in produzione su task non strutturati o ad alta variabilità, il gap con i top model rimane.

Altre cose da tenere a mente:

- Modello solo cloud per ora (nessun peso scaricabile in locale)

- Documentazione ancora in evoluzione

- Richiede prompting più strutturato rispetto a ChatGPT

- Controversie su copyright da monitorare (come per molti modelli cinesi)

- Restrizioni commerciali su alcuni modelli da verificare caso per caso

Cosa Significa Tutto Questo

MiniMax M2.7 non è il modello più potente in assoluto — ma potrebbe essere il modello più conveniente per deploy enterprise in molti casi d’uso specifici.

Il fatto che abbia partecipato alla propria evoluzione è più di un trick di marketing: è un segnale di direzione. AI CERTs analizza in dettaglio il Recursive Model Improvement e le sue implicazioni per i prossimi anni. I prossimi anni vedremo modelli sempre più capaci di ottimizzare se stessi. MiniMax lo sta esplorando per prima, con risorse computazionali limitate rispetto ai colossi americani.

Per le PMI italiane e i professionisti AI che cercano alternative scalabili: vale la pena testarlo, soprattutto per workflow di office automation, coding e research automation dove il costo API fa la differenza.

Hai già provato MiniMax M2.7? Condividi la tua esperienza nel gruppo Telegram BRIX-IA → t.me/brixia

Tag: #AI #MiniMax #LLM #Enterprise #AgentAI #BrixIA